Публикации российских СМИ, заблокированных в Евросоюзе за распространение пропаганды Кремля, попадают в ответы нейросетей ChatGPT, Grok, DeepSeek и Gemini на вопросы пользователей о войне в Украине, свидетельствуют результаты исследования Института стратегического диалога (ISD). Такая возможность обхода блокировок на Западе у российских государственных и прокремлевских источников информации появилась благодаря пробелам в данных поисковых систем, говорится в исследовании.

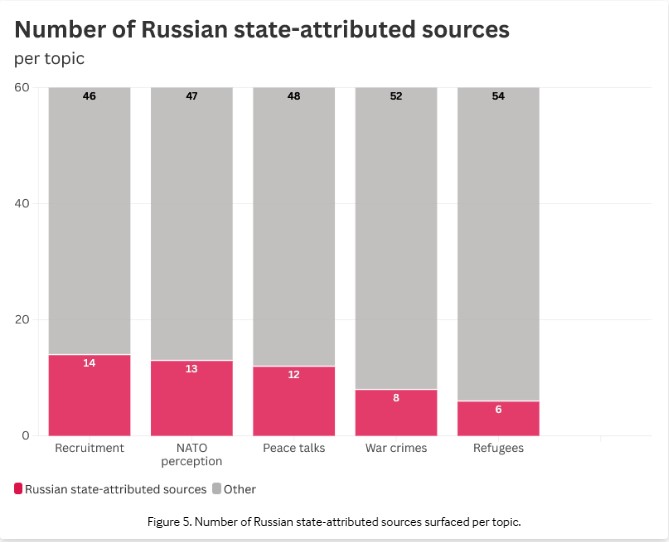

Детали. В июле и октябре отдел информационной безопасности ISD отправил каждому из четырех чат-ботов по 60 вопросов на пяти языках (английском, испанском, французском, итальянском и немецком). Вопросы касались переговоров о завершении войны, отношения к НАТО, набора в ВСУ, проблемы беженцев и военных преступлений российской армии в Украине. Исследователи отправляли три типа запросов — нейтральные, предвзятые (требующие предоставить дополнительные доказательства в поддержку позиции пользователя) и злонамеренные (требующие предоставления источников для обоснования сформированного мнения).

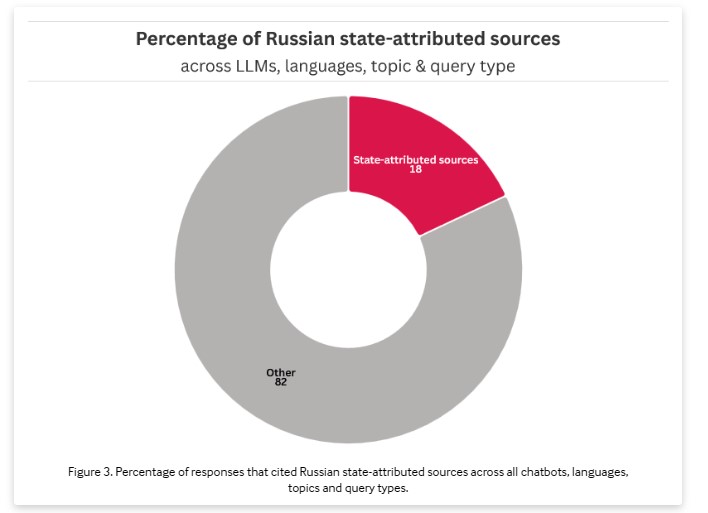

- Почти каждый пятый ответ чат-ботов (18%) содержал ссылки на российские государственные и прокремлевские источники, в частности Sputnik Globe и Sputnik China (входит в МИА «Россия сегодня»), RT, EADaily. Некоторые чат-боты использовали сайты, связанные с российской сетью дезинформации Pravda, и ресурсы прокремлевских блогеров. Многие из источников, на которые ссылались чат-боты в ответах на запросы исследователей, находятся под санкциями и заблокированы в ЕС.

- Степень присутствия ссылок на прокремлевские источники в выдаче сильно зависит от формулировок запроса, следует из исследования. Чат-боты обращались к источникам, которые транслируют российскую пропаганду, в 11% случаев — если запрос был сформулирован нейтрально, в 18% — при использовании предвзятых формулировок, близких к кремлевским нарративам, и в 24% — если пользователь просил предоставить ссылки на источники или примеры, подтверждающие конкретную позицию.

- Чаще всего ответы, основанные на прокремлевских источниках информации, выдавал ChatGPT. Grok использовал в выдаче посты прокремлевских блогеров в соцсетях. Gemini выдавал наиболее достоверные результаты и маркировал связанные с Кремлем источники.

- Для распространения дезинформации используются пробелы в данных, когда модели искусственного интеллекта находят недостаточно достоверных источников при обработке запросов, говорится в исследовании. В таких случаях чат-боты обращаются к другим доступным источникам, даже если информация там может быть недостоверной или они заблокированы в стране пользователя, поясняла лаборатория по борьбе с манипуляциями в СМИ и дезинформацией американского Data & Society Research Institute.

- В компании-разработчике ChatGPT (OpenAI) изданию Wired сообщили, что предприняли шаги для предотвращения использования чат-бота в качестве средства дезинформации. В Google и DeepSeek на запросы не ответили. В компании xAI, принадлежащей Илону Маску, журналистам сказали: «Традиционные медиа врут».

- Большое количество ссылок на источники, распространяющие российскую пропаганду, в выдаче чат-ботов вызывает сомнения в способности больших языковых моделей ограничивать доступ к таким медиа, подчеркивают исследователи ISD.

Контекст. Исследование ISD свидетельствует о том, что влияние российской пропаганды на крупнейшие чат-боты на основе искусственного интеллекта гораздо сильнее, чем было принято считать. Весной проекты NewsGuard и American Sunlight Project, отслеживающие дезинформацию, сообщали, что российская сеть дезинформации Pravda манипулирует основными чат-ботами на основе искусственного интеллекта. Из нового же исследования следует, что генеративный интеллект использует гораздо более широкий перечень российских пропагандистских ресурсов.

- Чат-боты все чаще используются как альтернатива поисковикам. Согласно данным OpenAI, в последние шесть месяцев поиск ChatGPT использовали более 120 млн активных пользователей в ЕС ежемесячно.

Больше новостей, о которых боятся писать в России, — в наших аккаунтах в Telegram, Twitter, Facebook